Inventarisatie 14 ministries Algoritmeregister

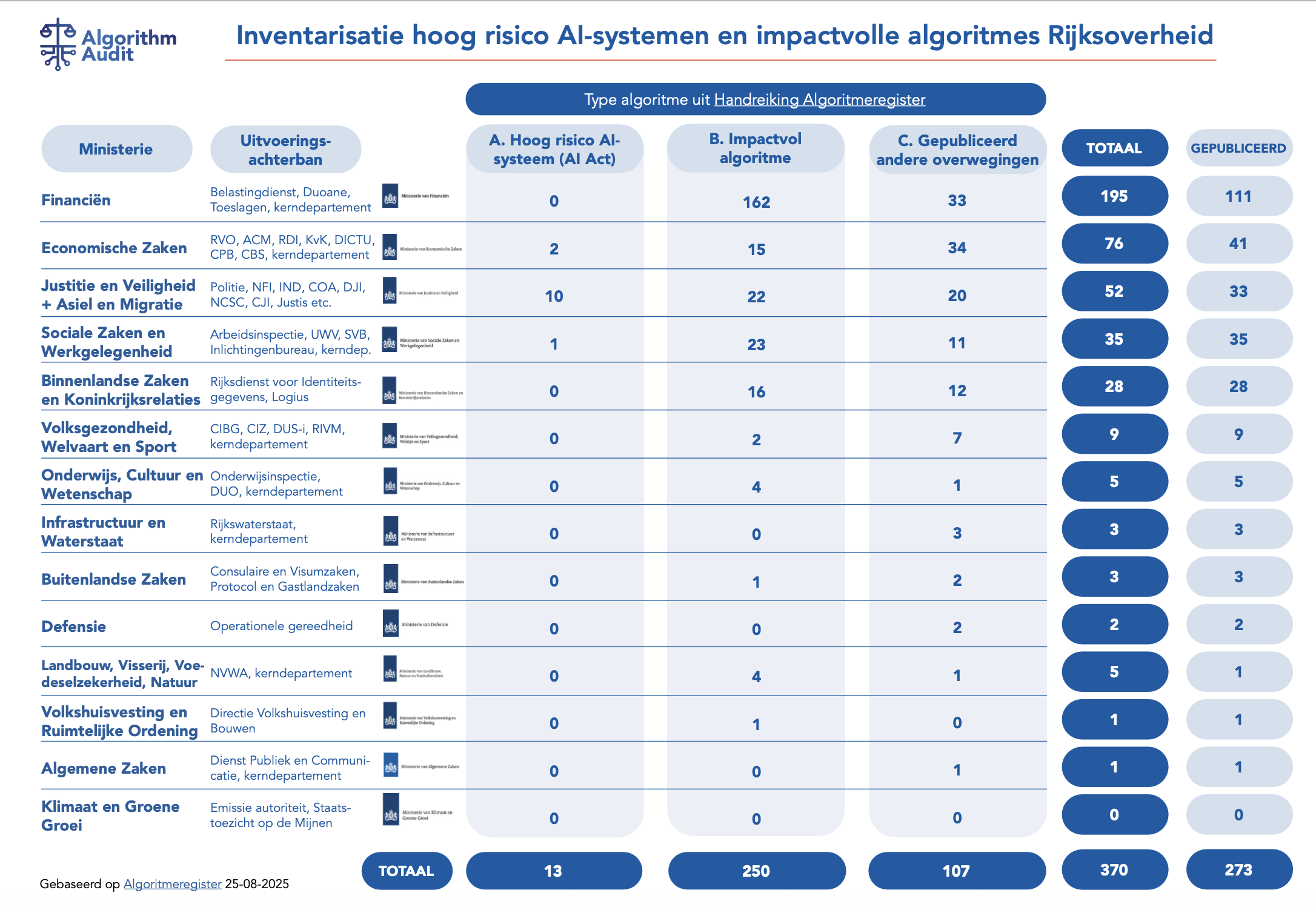

Afgelopen zomer publiceerden 14 Nederlandse ministeries hun inventarisaties van hoog-risico AI-systemen en impactvolle algoritmes in het Nationaal Algoritmeregister. Hieronder een samenvatting ⬇️

😮 Ongeveer 3,5% van de 370 geïnventariseerde algoritmes is geclassificeerd als een hoog-risico AI-systeem. Dit ligt ver onder de schatting van de Europese Commissie, die verwacht dat circa 15% van de algoritmische systemen in deze categorie valt.

❓Het is onduidelijk of de inventarisaties op een gestructureerde en consistente manier zijn uitgevoerd. Dit roept vragen op over de juistheid en volledigheid van zowel de identificatie als de risicoclassificatie van AI-systemen.

Voorbeelden:

- Monocam van de Nederlandse politie: gepubliceerd als ‘hoog-impact algoritme’ in het Algoritmeregister in plaats van ‘hoog-risico AI-systeem’. Volgens Annex III 6(d) van de AI Act zou dit als hoog-risico moeten worden aangemerkt, omdat het systeem de kans op een overtreding (telefoongebruik tijdens het rijden) bepaalt.

- In de brief van Economische Zaken wordt gesteld dat er geen algoritmes zijn geïnventariseerd bij ICTU, terwijl er wel één algoritme in het register staat.

- 273 van de 370 systemen van Nederlandse nationale instellingen zijn nu openbaar opgenomen in het Algoritmeregister, een belangrijke stap richting meer transparantie.

- Het Ministerie van Defensie identificeerde geen AI-systemen. Dit benadrukt het gebrek aan democratisch toezicht op AI die wordt ingezet voor veiligheid en defensie.

Meer algoritmes onder governance betekent een grotere behoefte aan consistente AI boekhouding. 🧮 Daarom biedt Algorithm Audit een gratis, open-source tool om algoritmische systemen te identificeren en classificeren. De tool wordt al gebruikt door meerdere Nederlandse publieke sector organisaties: https://algorithmaudit.eu/nl/technical-tools/implementation-tool/#tool